Centre de Réflexion

sur la Sécurité Intérieure

10 rue Cimarosa – 75116 PARIS

État des lieux et analyse d’une IA pour la sécurité intérieure

Par Benoit Fayet et Bruno Maillot,

*Consultant Défense & Sécurité Sopra Steria Next, membre du Comité stratégique du CRSI (g.)

*Expert Data et Intelligence Artificielle Sopra Steria Next (dr.).

Éléments de contexte

La majorité des Français expérimente l’IA sans parfois s’en rendre compte au quotidien : transports, commerce électronique, énergie, santé, domotique, agriculture etc. L’IA est en revanche moins présente dans le secteur de la sécurité et les métiers exercés par les Forces de sécurité intérieure (FSI), qu’ils soient policiers ou gendarmes nationaux alors que depuis des années l’informatique, les nouvelles technologies ont fait évoluer ces métiers, et que les Armées ou les Collectivités territoriales l’utilisent beaucoup plus sur des problématiques parfois proches. Les policiers et gendarmes nationaux s’appuient en effet aujourd’hui massivement sur le numérique, notamment pour :

- Leurs activités au quotidien avec des systèmes d’informations et des applications qu’ils utilisent pour prendre un dépôt de plainte, rédiger des procédures, consulter des informations sur un individu, ou avec le développement de la biométrie largement utilisée, pour identifier et authentifier des individus (prises d’empreintes digitales, etc.),

- Leurs échanges sur le terrain par des réseaux de communication adaptés, des outils mobiles pour les accompagner sur la voie publique ou en intervention.

- Le suivi de la délinquance notamment localement ou en cas de gestion de crise (vidéoprotection, centre de commandement, etc.)

- La prise en charge des victimes avec le développement récent de sites en ligne et applications présentant les mêmes offres qu’en unité (dépôt de plainte, signalement, etc.)

L’IA représente un levier décisif pour venir renforcer chacun de ces usages numériques actuels par les policiers et gendarmes nationaux. En effet, les outils numériques dont ils disposent déjà, les données qu’ils exploitent au quotidien et d’ores et déjà disponibles ainsi que leurs besoins opérationnels pourraient permettre cela, offrant ainsi une nouvelle révolution numérique au ministère de l’Intérieur.

En effet, l’IA n’est pas simplement un outil mais est une innovation disruptive [1] des métiers et des pratiques professionnelles et pourrait ainsi amener des transformations en profondeur pour les métiers exercées par les policiers et gendarmes nationaux, notamment ceux en tension et en crise comme en police judiciaire. L’IA pourrait en outre répondre aux multiples irritants du quotidien que les Français subissent sur le plan de la sécurité en permettant par exemple d’augmenter la présence policière sur la voie publique par la réduction du temps consacré par les policiers et gendarmes nationaux à des tâches techniques ou administratives en unité ou en augmentant concrètement leurs capacités d’enquête, en permettant d’améliorer les taux d’élucidation de certaines infractions ou délits. Les capacités analytiques de l’IA dans le traitement de données complexes par exemple pourrait également venir renforcer la lutte contre la criminalité organisée ou le narcotrafic.

Pour déployer des systèmes d’IA, de nombreux prérequis sont toutefois nécessaires, à commencer par une bonne maîtrise du cadre juridique national et européen relatif à l’IA. Ensuite, il est indispensable de poser le cadre politique de l’usage de l’IA afin d’en faciliter l’acceptation par les policiers et gendarmes nationaux eux-mêmes et par les Français [2] afin que l’IA soit identifiée comme un outil, non une fin en soi. La prise de décision et le contrôle devront toujours relever des forces de police, pour éviter de basculer dans « la civilisation des machines », comme le redoutait déjà Georges Bernanos dans La France contre les robots (1947).

Enfin, dans un contexte accru de cybermenaces et de menace sur nos souverainetés, il conviendrait de s’assurer de la maturité, de la résilience des technologies employées et de travailler à une nécessaire identification des outils les plus sécurisés. Un point de vigilance doit ainsi être évoqué concernant le manque de souveraineté technologique de l’UE et de la France sur des solutions d’IA provenant aujourd’hui majoritairement de l’espace extra-européen. Il convient donc d’identifier des outils d’IA qui ne permettent pas une perte de cette souveraineté et d’une vulnérabilité renforcée à des opérations d’intelligence ou d’influence.

Les objectifs de cet article sont donc d’analyser les potentialités permises par le cadre juridique actuel pour s’appuyer sur l’IA dans le secteur de la sécurité intérieure et d’identifier des usages opérationnels concrets, réalistes à un horizon rapproché et maîtrisés d’un point de vue technologique.

Des premiers usages de l’IA en cours, une bascule avec les JO de Paris 2024 ?

Des projets existent déjà en France, que ce soit sur la voie publique dans le traitement de la délinquance, sur des activités à caractère administratif ou d’investigation. De récentes innovations autour de l’IA ont été permises avec les JO de Paris 2024.

De l’IA utilisée pour aider à la prise de décision dans la lutte contre la délinquance

L’IA a d’ores et déjà été sollicitée car elle répond parfaitement au cœur de métier des Forces de sécurité intérieure (FSI), à savoir l’anticipation et la prévention de faits, en l’occurrence de délinquance. L’IA a été développée non pas pour les prédire mais pour mieux les comprendre, les analyser et in fine aider à décider. En effet, la délinquance n’est pas un fait aléatoire et peut être analysée en récupérant des données statistiques sur un territoire défini et alimenter des modèles permettant aux FSI de mieux opérer au quotidien sur ce territoire (localisation, horaires des patrouilles, etc.). Des méthodes analytiques ont été utilisées par la Gendarmerie nationale sur des données non personnelles issues du Service Statistique Ministériel de la Sécurité Intérieure (SSMSI) et ensuite exploitées par de la data visualisation pour cartographier et suivre l’évolution de la délinquance sur un territoire. Il ne s’agit donc pas d’outils de police prédictive, car ils ne prévoient rien mais d’analyse décisionnelle sur des faits passés et qui peuvent fournir une orientation aux FSI qui ne peuvent croiser autant de données sans la capacité d’analyse de l’IA. La méthode consiste à regarder à titre d’exemple où ont eu lieu des cambriolages et des atteintes aux véhicules sur une période donnée et un territoire pour en déduire où risque de se produire les prochains. L’idée est de s’en servir pour cibler des territoires précis et planifier l’engagement de FSI où l’infraction risque de se produire et dissuader la délinquance.

D’autres expérimentations avec des outils plus prédictifs allant au-delà de l’aide à la décision et comprenant une prédiction en termes de risque ou d’occurrence ont aussi été réalisées mais n’ont pas démontré leur plus-value opérationnelle.

De l’IA développée pour aider au traitement de données en police judiciaire

Des premiers outils de traitement de données à base d’IA ont aussi été développés par la Gendarmerie nationale pour appuyer des phases d’enquête et d’investigation. Des outils peuvent ainsi être employés pour appuyer les FSI dans la surveillance de communications dans le cadre d’une enquête pour détecter des langues parlées dans des écoutes téléphoniques autorisées par un juge d’instruction, pour retranscrire et traduire les échanges, identifier et signaler les sujets pertinents pour l’enquête via des réseaux récurrents de neurones.

De même, un projet a été développé permettant la retranscription d’audition filmée d’une victime et offrant un outil d’annotation des objets d’un texte de procédure (personnes, lieux, date, objets, etc.).

Enfin, l’Agence du numérique des Forces de sécurité intérieure (ANFSI), en charge du développement de leurs équipements numériques, expérimente un outil de réalisation du compte rendu d’intervention simplifié par « commande vocale » sur les outils mobiles NEO [3].

Un tournant décisif avec les JO de Paris 2024 ?

A l’occasion des JO de Paris 2024, la « vidéo augmentée » a été autorisée en Île-de-France, sous la supervision de la préfecture de Police de Paris. La loi du 19 mai 2023 [4] a permis en effet, pour la première fois, la mise en œuvre de solutions d’IA dans la vidéoprotection, dans un cadre strict excluant l’utilisation de la reconnaissance faciale. L’expérimentation ne visait que la détection d’évènements prédéterminés à savoir la présence d’objets abandonnés, la présence ou utilisation d’armes, le non-respect par un véhicule du sens de ce circulation ou d’une zone interdite, les mouvements de foule et les départs de feux. L’article 10 a notamment autorisé la mise en œuvre de l’IA sur certains flux vidéo à partir de caméras fixes [5] aux fins de détecter certaines situations pour sécuriser les événements particulièrement exposés à un risque terroriste ou d’atteinte à la sécurité des personnes. Un comité d’évaluation de ces caméras algorithmiques doit remettre un rapport d’ici la fin de l’année 2024. D’ores et déjà, plusieurs cas d’usage de la vidéoprotection intelligente ont été jugés très efficaces, notamment ceux qui ont permis une détection d’individus dans des zones non autorisées, facilitant en outre l’ajustement de la présence policière dans ces zones, une détection d’une densité de population ou de mouvements de foule (liés à des rixes, etc.) ou encore des interpellations dans les transports urbains.

En synthèse, si des projets existent, ceux-ci restent toutefois à la marge, loin d’un passage à l’échelle généralisé qui devrait s’inscrire en outre dans un cadre juridique contraint et évolutif.

Un cadre juridique national clair et récemment renforcé au niveau européen avec l’IA Act

En France, un cadre strict avec la CNIL, des tentatives politiques pour avancer

La CNIL a formulé plusieurs recommandations précises [6] afin de veiller à des déploiements de systèmes d’IA respectueux de la vie privée des individus en suivant les dispositions de la loi « Informatique et Libertés » de 1978 ou la directive européenne dite « Police-Justice » [7] de 2016 définissant les règles relatives à la protection des données à l’égard de systèmes d’informations utilisés par les FSI. Les autorités publiques responsables de systèmes d’IA ont ainsi des obligations de transparence afin de rendre publiques les évaluations de ces systèmes et doivent suivre le principe de double proportionnalité, qui assure que l’usage de l’IA est justifié selon le cadre opérationnel (patrouille, enquête pour un délit, crime ou une menace terroriste) et le type de données utilisées (données personnelles, statistiques, etc.). Pour la CNIL, il convient donc d’appliquer aux systèmes d’IA les règles du droit commun des données (durées de conservation, contrôle indépendant, etc.).

En parallèle, le ministère de l’Intérieur et le pouvoir législatif ont avancé sur cette ligne de crête tracée par la CNIL que ce soit via le livre blanc de la Sécurité Intérieure (2020) [8] ou la Loi d’Orientation et de Programmation du ministère de l’Intérieur (LOPMI, 2023) [9], qui ont notamment formulé puis encadré par la loi les cas d’usage pouvant justifier l’utilisation de l’IA dans le secteur de la sécurité. Un cadre avait aussi été proposé pour des expérimentations, en perspective des JO de Paris 2024 : anonymisation des données, stockage sécurisé, prise de décision et maintien d’un contrôle des technologies par des agents.

Un cadre renforcé au niveau européen avec l’IA Act

Complétant ce cadre national, la Commission Européenne a élaboré un règlement, l’IA Act, visant à encadrer l’utilisation de l’IA en Europe, voté par le Parlement européen en décembre 2023 [10] et qui entrera en application en août 2026. L’objectif est de garantir que les systèmes d’IA utilisés dans l’Union Européenne soient sûrs, transparents et sous contrôle humain. Une vigilance accrue est portée sur les IA génératives qui créent des textes, du code et des images. L’IA Act apporte ainsi un cadre juridique précis concernant les usages dans la sphère publique et en particulier pour ce qui concerne la sécurité :

- Des IA sont interdites car dangereuses : identification biométrique dans les espaces publics, base de données de reconnaissance faciale (dont permettant une comparaison avec des données en open source), système de police prédictive, etc.

- Des IA sont encadrées car à haut risque avec de la documentation à fournir, un contrôle humain, des impératifs de conformité, de l’évaluation continue : système de catégorisation biométrique, gestion de la migration, etc.

- Des IA à risque limité sont permises avec obligation de transparence : système de détections d’objets, etc. [11]

Il est à noter que l’IA Act fournit des exceptions notamment dans le cadre d’opérations de maintien de l’ordre permettant de la reconnaissance faciale « à distance » (avec caméra ou drone), « sous réserve d’une autorisation judiciaire préalable et pour des listes d’infractions strictement définie » concernant « la recherche d’une personne condamnée ou soupçonnée d’avoir commis un crime grave ».

Les perspectives d’usage et d’application de l’IA dans le secteur de la sécurité intérieure

Compte tenu des réflexions déjà engagées et du cadre réglementaire posé, il convient désormais de se projeter sur les apports concrets que l’IA pourrait amener dans les métiers de la sécurité exercés par la police et la gendarmerie nationales, en s’appuyant sur les technologies existantes, les développements récents notamment autour de l’IA générative, et en identifiant les conditions pour de tels usages : échanges et communications, accès à la donnée, simplification des tâches techniques, analyse de la donnée dans les phases d’enquête, etc.

Il est important de rappeler que les usages identifiés dans cette note le sont dans une démarche prospective qui tient compte du cadre juridique évoqué précédemment et s’inscrivent dans un usage de l’IA soucieux d’apporter une plus-value opérationnelle aux FSI tout en ne transigeant pas sur les enjeux éthiques de protection des données, d’un usage raisonné des données loin des pratiques de certains pays non européens qu’il convient d’éviter pour préserver notre modèle démocratique français. L’IA doit venir en appui des FSI, sans devenir « l’agent », c’est-à-dire que les tâches qui pourraient être confiées à une IA devront rester sous la primauté humaine en contrôle et en validation. Cette délégation doit ainsi accélérer l’action, la décision mais ne doit pas créer une dépendance. Il s’agit donc d’identifier les bons cas d’usage, sur les activités notamment à non ou faible valeur ajoutée afin de maintenir chez les FSI la capacité à prendre les décisions et à faire preuve d’agentivité [12].

L’IA, pour optimiser les échanges et la communication entre les FSI

Dans un contexte sécuritaire fortement dégradé, les enjeux autour de la communication et du partage de la donnée entre FSI sont clés que ce soit au quotidien en patrouille ou en intervention en termes de conduite à tenir (connaissance de la situation, des individus, etc.) ou a fortiori en cas d‘opérations contre des narcotrafiquants ou des situations plus graves (attentats, etc.).

Des cas d’usage précis, comme la capacité à centraliser puis traiter les données issues des équipements mobiles des FSI ou issues de caméras de vidéoprotection (vidéo, voix, radio, dialogues et appels entre FSI) sont aujourd’hui irréalisables et pourrait l’être en s’appuyant sur des outils intégrant de l’IA, alors que le nombre de données collectées ne cesse de croître. Ces facilités permettraient d’être plus performants grâce à une proximité renforcée et une facilité à se projeter dans les situations opérationnelles et pourraient être intégrées au programme en cours de transformation des moyens de communication des FSI via la mise en place d’un réseau mobile très haut débit [13]. L’IA peut être un atout majeur pour aider au partage d’informations et de renseignements et pour que ceux-ci arrivent plus vite au niveau des policiers et gendarmes nationaux, pour qu’ils puissent traiter le problème identifié avant qu’il ne se détériore, dans le cas par exemple de détection de signaux faibles en lien avec les Cellules de renseignement opérationnel sur les stupéfiants (CROSS) ou la démarche partenariale entre élus, polices municipales, associations, permet d’échanger des informations qu’un outil d’IA peut traiter et qualifier rapidement.

L’IA, pour produire de la connaissance et appuyer l’action des FSI en temps réel

Produisant de plus en plus de données, notamment grâce à leurs outils mobiles, les FSI réalisent leurs missions dans un environnement où les données produites par des tiers sont en outre de plus en plus nombreuses. Face à cette double évolution, une stratégie de valorisation de ces données avec l’IA pourraient être développée combinant de l’analyse des données du passé, notamment dans des outils décisionnels déjà existants mais aussi de l’enrichissement de l’information opérationnelle en temps réel (géolocalisation des patrouilles, notes d’analyse transmises par de l’IA générative, etc.), le développement algorithmique et la valorisation de certaines données depuis l’extérieur (dans le respect des exigences posées par l’IA Act) avec par exemple l’analyse des données réelles des flux de déplacement de personnes dans les différents réseaux de transports urbains d’une métropole dans le cas d’une mission d’interpellation ou également en sécurité routière dans la gestion du trafic, en détectant en temps réel les accidents ou les perturbations, facilitant ainsi des réponses immédiates et informées.

L’une des caractéristiques apportées par l’IA est sa capacité à signaler automatiquement des incidents. Si des conditions ou des scénarios prédéfinis sont détectés, tels que des rixes ou des mouvements de foule, un système à base d’IA peut générer automatiquement des rapports d’incidents détaillés et envoyer des alertes aux FSI pour évaluer la situation. Cela accélère non seulement le processus de documentation, mais garantit également que même des infractions ou incidents mineurs (incivilités, dégradations), qui pourraient être négligés, soient remontés et traités.

De plus, la multiplication des données disponibles peut permettre de disposer en temps réel d’un nombre croissant d’informations. La situation tactique pourrait ainsi être enrichie par des données opérationnelles (géolocalisation des patrouilles, y compris d’autres acteurs « producteurs » de sécurité comme les polices municipales, la sécurité privée, géolocalisation d’une personne ciblée par une enquête ou une intervention), des données de contexte (points d’intérêt, densité, état des réseaux, etc.) et des données de capteurs (caméras piétons, etc.). L’IA peut aller chercher ces données nombreuses et diverses, les structurer et les rendre en temps réel aux FSI sur le terrain en voie publique pour des délais d’intervention plus rapides par exemple (communication automatique de données, etc.).

L’enjeu dans ce cas est de bien définir les besoins et les cas d’usage pour disposer de données pertinentes, exploitables et de travailler à la restitution (notamment par de la cartographie) ou à l’automatisation de la présentation des données dans les SI utilisés par les FSI ou leurs outils mobiles.

L’IA, pour faciliter, accélérer et rendre plus simple les tâches administratives et techniques des FSI

Les FSI déplorent que leur temps de travail soit de plus en plus consacré à des tâches administratives et rédactionnelles répétitives, lourdes et sans valeur ajoutée. L’apport de l’IA pour ce type de tâches techniques de « back-office » est largement répandu dans d’autres secteurs d’activité notamment avec l’IA générative qui bascule de l’analyse passive à la création active de contenus.

Ainsi, l’IA appliquée à ces tâches techniques en les automatisant pourrait permettre de faire gagner du temps aux FSI dans leurs activités au quotidien sur ce même type de tâches et les recentrer ainsi sur leur cœur de métier afin de permettre plus de présence sur le terrain, dans la rue en patrouille afin de renforcer le lien avec la population, dissuader et prévenir des faits de délinquance. Un des retours d’expérience des JO de Paris 2024 est que la présence massive et visible de FSI dans la rue a été non seulement efficace, mais aussi appréciée des populations.

Appuyer la rédaction des procédures, collecter des informations

L’IA ouvre ainsi de nombreuses fonctionnalités pour faciliter voire supprimer des tâches répétitives et chronophages qui constituent le quotidien des FSI dans des procédures de verbalisation (rédaction de procès-verbaux, etc.) d’interpellation, de prise de dépôt de plainte ou d’enquête. Sur des phases rédactionnelles et de transcription, l’IA pourrait permettre d’aller plus vite dans la rédaction de procès-verbaux que ce soit en unité ou en mobilité [14] via de la génération automatisée de texte ou de propositions de texte (par exemple réglementaire), l’extraction d’informations d’intérêt dans des documents, l’accélération du traitement de bandes vidéo par élimination ou sélection de scènes sur requête sémantique, le masquage de passages, extraits ou parties de documents (identification d’une partie spécifique ou d’un segment dans une masse de vidéos via des « transformers », etc.).

L’usage de l’IA dans ce cadre se ferait sur la base de réseaux récurrents de neurones interprétant des flux de données et qui ont une mémoire des textes, des enchaînements de mots ou de phrases comme des réseaux de neurones biologiques mais avec une puissance de calcul multipliée et peuvent donc apporter de la valeur sur des activités rédactionnelles et de transcription.

Afin de permettre aux FSI de travailler plus efficacement, l’IA pourrait également démultiplier l’efficacité d’outils déjà en place au ministère de l’Intérieur comme l’intégration du traitement du langage naturel dans les outils du quotidien (réalisation de rapports ou de procès-verbaux par commandes vocales par exemple dans la rue, etc.). L’IA est ainsi un levier pour donner plus de temps aux FSI pour se concentrer sur des tâches à valeur ajoutée, en leur permettant par exemple pendant les temps de garde-à-vue de travailler un dossier, d’interroger un individu plutôt que de consacrer ce temps court [15] à des actes administratifs et techniques.

Vérifier des faits, aider à la recherche de preuves

Le recueil des déclarations, des témoignages, les différentes auditions constituent la base du travail d’investigation et souvent le premier pas dans la recherche des contradictions ou la vérification des faits. Les centaines de pièces qui viennent bien souvent enrichir un dossier sont encore essentiellement transcrites par un enquêteur, mais de plus en plus fréquemment, ou lorsque cela est prévu par la loi, elles sont filmées et enregistrées. A terme, elles pourraient être directement enregistrées et retranscrites automatiquement par un système à base d’IA constituant des données pouvant ensuite être rapidement exploitées et confrontées par les FSI qui pourront ainsi se concentrer sur l’analyse, la recherche de faits et in fine améliorer le taux d’élucidation des affaires.

Rechercher des informations dans les systèmes d’information

L’IA pourrait aussi permettre de faciliter les travaux de recherche d’informations sur un individu ou un groupe d’individus interpellés ou recherchés. Ces phases de recherche sur des données biographiques, des données sur des antécédents judiciaires sont le quotidien des FSI et se font dans les différents fichiers de police mis à leur disposition (FPR, TAJ, etc. [16]). Ces fichiers de police fonctionnent en silo et communiquent peu entre eux, notamment dans le but de respecter leurs finalités de traitement, conformément aux principes de la CNIL. Ainsi, le partage d’informations entre les fichiers est limité à des interfaçages applicatifs, et les FSI doivent souvent consulter un ou plusieurs fichiers en parallèle. Au regard de la profusion de données et du volume à analyser quotidiennement, l’IA pourrait permettre de dépasser cette problématique et faciliter la vie des FSI en leur apportant l’information agrégée. Cette capacité d’agrégation est un des apports majeurs de l’IA qu’il convient d’appréhender au regard du cadre juridique énoncé par la CNIL mais qui peut permette d’offrir la possibilité aux FSI de disposer plus facilement et plus rapidement des informations qu’ils recherchent, phase clé que ce soit pour leur sécurité personnelle en cas d’interpellation (disposer de l’information de la conduite à tenir rapidement vis-à-vis de l’individu interpellé), pour améliorer l’efficacité des contrôles sur la voie publique (garantie d’identifier la bonne personne par exemple dans le cas d’un contrôle) et enfin dans le domaine de la police judiciaire. L’IA pourrait ainsi utilement appuyer par exemple des rapprochements de données, désormais autorisés entre les systèmes de lecture automatisée des plaques d’immatriculation (LAPI) avec d’autres systèmes d’information, comme le fichier des véhicules volés, celui des données relatives à l’assurance des véhicules ou encore le système de contrôle automatisé [17]. Cette capacité d’agrégation de l’IA pourrait aussi permettre de faciliter le recours à des saisies sur compte bancaire via les systèmes d’information du ministère de l’Economie et des Finances, pour améliorer le recouvrement des amendes, notamment les amendes forfaitaires délictuelles (AFD), ou pour s’adresser directement au « portefeuille » de certains délinquants, volonté politique affichée du Ministre de l’Intérieur, Bruno Retailleau.

Fiabiliser les fichiers de police et leurs usages

A côté de la consultation, une tâche récurrente consiste à également « alimenter » les fichiers de police sur des individus interpellés ou recherchés, avec des éléments descriptifs de faits, d’infractions, et surtout d’informations sur leurs identités (biographiques ou biométriques). Cette phase est clé, notamment pour ce qui concerne l’acquisition de données biométriques, car elle préfigure ensuite de la qualité des bases de données et permet ensuite dans le cas d’une infraction ou d’un crime d’authentifier des individus interpellés mis en cause ou des individus victimes. La puissance des algorithmes d’IA peut ainsi identifier et mettre en évidence les minuties (points spécifiques sur une empreinte digitale) avec plus de précision que l’œil humain, conduisant à des comparaisons plus précises.

L’interrogation des fichiers de police comportant les bases de données d’empreintes digitales ou génétiques pourrait aussi être automatisée avec l’IA pour aller plus vite et fiabiliser les comparaisons. Par ailleurs, la mise en œuvre d’une automatisation des contrôles de qualité technique permettrait de sécuriser la qualité d’acquisition des données par une application d’aide à la prise de vue des empreintes et de détecter automatiquement les empreintes photos non conformes. De même, l’IA pourrait être bénéfique pour la prise en compte des empreintes digitales laissées involontairement sur des surfaces (dites « latentes ») qui peuvent être parfois partielles, floues ou de mauvaise qualité. L’IA pourrait combler les parties manquantes en se basant sur des motifs reconnus, permettant de meilleures correspondances.

L’IA, pour renforcer les activités d’analyse des FSI et mieux combattre la délinquance

Travailler sur des grandes masses de données

L’IA offre des opportunités de calcul et d’automatisation de certaines tâches pour les FSI confrontées à des masses de données à traiter, que ce soit dans des tâches administratives (criblage, etc.) ou des activités de police judiciaire. Des agents du ministère de l’Intérieur ont par exemple la charge d’activités de « criblage » des personnes embauchées sur des métiers sensibles auprès de l’ensemble des fichiers de police à analyser pour « valider » la personne concernée. Sur ces activités d’analyse de masse sur des fichiers de données sécurisées, un apport par de l’IA pour aller plus vite et fiabiliser les enquêtes pourrait amener de la valeur et concentrer l’œil humain sur l’essentiel ou permettre un contrôle et une décision in fine plus rapide. L’IA pourrait offrir aussi la possibilité d’optimiser les activités de contrôle par une automatisation des détections de cas de consultation anormale des fichiers de police.

Sur des phases d’enquête et d’investigation, il pourrait être également opportun de s’appuyer sur l’IA pour de la recherche de données et la comparaison avec des bases de données importantes pour renforcer les taux d’élucidation de crimes, par exemple avec la comparaison génétique et le fichier dédié des empreintes génétiques (FNAEG). L’analyse ADN est une des méthodes les plus employées par la police scientifique pour identifier l’auteur d’un crime. De plus, l’IA pourrait faciliter les enquêtes judiciaires ou les pièces et dossiers sont toujours plus volumineux et complexes. Devant la multiplicité et l’hétérogénéité des données, la puissance de calcul de l’IA peut permettre de mieux les classer, les lier entre elles et se souvenir de tout dans un délai très court. L’enquêteur pourrait donc analyser et confronter plus rapidement, avec moins d’erreur pour in fine améliorer les taux d’élucidation des affaires.

Ensuite, la plupart des données d’une enquête judiciaire sont stockées sur des disques durs afin d’être conservées. Des outils d’assistance à même de croiser et lier ces données sont nécessaires pour identifier des indices parmi les grandes masses de données disponibles. L’IA pourrait accomplir ce travail de classification et de connexions entre les faits et les indices, qui sont retrouvés dans les dossiers judiciaires. Un enjeu clé est la gestion de volumétrie de masse pour la donnée judiciaire, pour aller plus vite dans des processus d’enquête et d’investigation, sur la voie publique ou en intervention pour permettre une décision plus rapide. Il s’agit, ici aussi, de bien définir les cas d’usage et d’entraîner au préalable les systèmes à base d’IA pour assurer une pertinence des analyses via de la génération de données synthétiques.

Mieux analyser et interpréter des images, des sons et en grande quantité

L’IA générative introduit de nouvelles techniques qui permettent d’analyser et interpréter des images. Les développements génératifs de l’IA peuvent apporter beaucoup dans l’exploitation d’images en phase d’enquête, en étant capable de comprendre des requêtes, de sortir les éléments demandés d’une image, avec une capacité à exploiter des images en grande quantité avec des données hétérogènes. Ces solutions pourraient permettre d’appuyer les phases d’enquête par l’analyse de photos de scènes de crime, d’accident de la route ou d’images issues d’un centre de supervision urbain (CSU) et identifier ainsi des images d’intérêt (détection de véhicules, de personnes, etc.). De même, la vision par ordinateur pourrait devenir un atout majeur grâce à l’utilisation de réseaux neuronaux qui permettent d’interpréter et d’analyser à large échelle des informations visuelles complexes. Ces réseaux inspirés du fonctionnement du cerveau humain peuvent avoir un intérêt pour de la détection de surfaces spécifiques à partir de photographies aériennes ou d’images satellites qui peuvent être utiles aux policiers nationaux et gendarmes pour identifier des véhicules recherchés, des points de deal, etc.

L’IA permettra ainsi une plus grande vigilance dans l’observation d’images de vidéoprotection et donc une meilleure efficacité et une accélération de la réponse à apporter à des situations suspectes (points de deal, rixes, rassemblements, etc.). En effet, il est estimé qu’un opérateur d’un centre de supervision ou de commandement, au bout d’une heure d’observation d’images ou de vidéos en temps réel, perd de sa vigilance et potentiellement 50% des événements peuvent lui échapper. A terme, un opérateur d’un centre de supervision ou de commandement pourrait avec des systèmes d’IA ne plus regarder de flux en temps réel mais se concentrer sur de la levée de doutes, de l’analyse et de la prise de décision.

L’IA peut en effet accélérer le processus d’analyse actuellement effectué par l’œil humain et donc de détection via des outils effectuant de l’analyse d’image et de l’analyse comportementale avec des algorithmes de réseau à convolution capables de repérer des objets, des faits ou des individus. Actuellement les techniques d’apprentissage permettent de retrouver la photo d’un individu, d’un objet, d’une arme parmi les milliers de photos contenues communément dans un ordinateur, un téléphone. Les techniques d’apprentissage de l’IA dédiées à la reconnaissance d’objets ou de formes dans un contenu constituent un apport non négligeable.

Enfin, l’IA peut apporter beaucoup avec les technologies de reconnaissance vocale qui peuvent déchiffrer les caractéristiques vocales propres à chaque individu, convertir les mots parlés en modèles qui peuvent être exploités, comparés à des empreintes vocales stockées (échantillons vocaux provenant d’appels téléphoniques ou d’enregistrements).

Mieux analyser et détecter rapidement

Le recueil d’information en source ouverte (OSINT, SOCMINT) est une pratique désormais commune et répandue du fait de la multiplicité des données disponibles (réseaux sociaux, etc.). L’appui de l’IA sur ces phases de recueil d’information est fondamental pour détecter et caractériser rapidement des situations de danger et d’urgence à une vitesse supérieure à celle à laquelle des réseaux criminels ou des narcotrafiquants peuvent effacer leurs traces numériques par exemple ou pour réaliser par exemple de la veille pour analyser le « bruit informationnel » (web scraping, etc.), en intégrant le cadre fixé par l’IA Act (exclusion de la reconnaissance faciale, etc.), pour détecter et contrer de la propagande ou de la désinformation. En utilisant des algorithmes avancés d’IA et d’apprentissage automatique, il est possible d’analyser de vastes quantités de données à grande vitesse pour identifier des motifs, des mots-clés ou des contenus visuels, ce qui peut être décisif dans des enquêtes d’ampleur par exemple (narcotrafic, criminalité organisée). De plus, les systèmes pilotés par l’IA peuvent être entraînés sur des matériaux de propagande ou de désinformation connus pour repérer de manière proactive de nouveaux contenus partageant des caractéristiques similaires et les signaler, assurant une suppression réactive et efficace de ces contenus avant qu’ils ne se propagent.

Pour assurer l’efficacité de ces outils, l’enjeu réside dans la capacité à gérer des données structurées (mots, signes, chiffres, etc.) et non structurées à grande échelle (images, sons, vidéos, etc.), de disposer de plateformes pour les traiter et les rendre exploitables grâce à des modèles d’apprentissage automatiques auto-apprenants, ces outils pouvant en effet reformater ces données non structurées. Les technologies d’analyse automatisée du langage écrit, qui reposent sur l’IA, permettent de procéder à de l’analyse et de l’extraction de contenus, et traitent des volumes d’informations qu’il serait impossible de réaliser manuellement.

L’IA peut enfin permettre d’accéder à une vitesse de réponse plus rapide, via l’apprentissage automatique par exemple en donnant une multitude de données à un système d’IA qui va apprendre, au fur et à mesure, à les traiter automatiquement. Par exemple, un suivi de la trace du véhicule d’un auteur de crime en fuite est possible à travers les caméras de surveillance, l’analyse des vidéos se fera plus rapidement qu’une analyse humaine qui peut alors se concentrer sur l’exploitation des données et le contrôle de l’usage. L’IA pourrait permettre d’appuyer des opérateurs d’un centre de supervision urbain dans leurs activités : détection de déchets, d’objets abandonnés, d’armes ou de départ de feu, calcul du temps de présence d’un véhicule, stationnement près de lieux sensibles, passage feux rouges, franchissement de lignes, analyse de mouvements de foule, etc.

L’IA, pour augmenter les capacités d’enquête et d’élucidation des faits

Les volumes de données à exploiter en phases d’enquêtes (flux vidéos, images) sont telles que leur exploitation est désormais impossible sans aide numérique. L’augmentation considérable de la volumétrie des données numériques génère une contrainte sur la capacité des FSI à les exploiter. L’utilisation de l’IA devient ainsi une nécessité, et à terme une condition indispensable de la capacité d’exploitation de données ou informations pouvant contribuer à l’établissement d’une preuve. Il est donc nécessaire que les FSI disposent d’outils de rationalisation de l’analyse vidéos, les assistant dans des phases d’enquête permettant de libérer un enquêteur de la visualisation de la totalité de sources vidéos ou d’images, ce qui fera gagner du temps et sera plus efficace, évitant toute perte de concentration dans la visualisation de ces flux et offrant la possibilité de se consacrer à des tâches d’analyse à plus grande valeur ajoutée. A défaut d’IA, il peut être considéré en outre que des enquêteurs renonceraient dans certaines affaires, faute de temps, à une exploitation systématique des sources vidéo disponibles et donc de preuves numériques particulièrement efficaces.

Parmi les éléments d’enquêtes, les enquêteurs disposent souvent d’auditions, de relevés bancaires, téléphonique, et des déclarations qui pourraient faire l’objet d’exploitation par des logiciels à base d’IA dédiés à relever des incohérences, à les repositionner dans une échelle de temps et géographiques ou à générer des schémas relationnels. L’incrémentation de ces données à partir des documents papiers ou numériques est longue. Les outils de l’IA pourraient permettre de détecter ces éléments directement dans des textes, à les identifier et les classer selon leur signification et à générer automatiquement des schémas relationnels. Le gain de temps et la souplesse d’emploi de ces outils offrent un apport réel avec par exemple la capacité de procéder à des classements et des liens, en temps réel à partir d’enregistrements sonores ou numériques, à suggérer des questions qui appuieront le travail des enquêteurs pour leur permettre d’identifier et interpeller plus vite.

L’IA pourrait aussi permettre des détections en temps réel et sur des flux très importants de faux documents, de fraudes que des agents ne peuvent faire et permettre ainsi de meilleurs taux d’élucidation des affaires. Dans les domaines de l’identité, les applications peuvent être multiples ainsi que dans le domaine de la sécurité routière que ce soit pour lutter contre la fraude au permis de conduire, la fraude à l’assurance ou contre des démarches frauduleuses, spécifiques et répétitives (fraudes liées à la contestation en cas d’amendes routières, fraude à l’immatriculation, vols de véhicules, etc.). Enfin, en utilisant des outils d’analyse pilotés par l’IA, les enquêteurs pourraient analyser des millions de transactions financières et détecter des volumes importants de données, tels que des mouvements de fonds suspects pour identifier des opérations de blanchiment difficiles à appréhender. Cela se traduirait concrètement par une capacité accrue à analyser et comprendre les schémas criminels, les connexions et environnements de mise en cause, à détecter des liens et faciliter la lutte contre des réseaux criminels organisés (narcotrafic, etc.). Récemment, les démantèlements de l’outil de communication cryptée EncroChat ou de la messagerie cryptée Matrix ont démontré le rôle crucial de l’analyse de données complexes.

Enfin, l’IA pourrait venir sécuriser les exploitations par les FSI d’images, de documents, de vidéos en automatisant le masquage de passages, extraits ou parties de documents à des fins de renforcement de la protection des données personnelles et du respect de la vie privée dans la lignée des recommandations de la CNIL et de l’IA Act. L’IA peut en effet détecter des éléments dans une donnée non structurée comme une image via des réseaux à convolution et opérer un filtre sur ce qui a été défini au préalable comme étant à masquer. L’utilisation de l’IA peut aussi permettre d’exploiter avec précision et rapidité des outils comme les caméras-piétons pour établir des preuves, dans le cas par exemple d’une mise en cause des FSI dans le cadre d’une intervention.

L’IA, pour renforcer la prise en charge des victimes

Depuis quelques années, des sites en ligne ou applications sont déployés par le ministère de l’Intérieur permettant de signaler et déclarer des faits, de procéder à un dépôt de plainte [18] ou d’accéder à des informations en ligne (localiser une brigade ou un commissariat, etc.) [19]. Ces sites offrent des possibilités pour les citoyens en termes de démarches et aussi un levier concret de développement des usages autour de la donnée. Il s’agit d’un nouveau « gisement » de données bien souvent structurées (mots, signes, chiffres, etc.) qu’il conviendrait de développer et valoriser par de l’IA (cartographies des signalements, localisation de données sur la délinquance, types de faits par localisation, etc.) ou pour mettre à disposition des FSI sur le terrain en voie publique pour des délais d’intervention plus rapides par exemple (production de statistiques et de communication automatiques, etc.).

Par ailleurs, le développement de ces sites offre l’opportunité de réfléchir à de nouveaux usages de collecte d’informations et de renseignements. Ces sites pourraient s’inscrire dans une logique de renforcement des capacités de détection des signaux, même faibles, via de l’IA dans un contexte sécuritaire qui impose de diversifier les canaux de remontée des signalements en mobilisant tous les capteurs disponibles.

L’IA, pour faire évoluer la relation entre la police et la population

L’IA pourrait aussi faciliter des démarches type dépôt de plainte ou renouvellement de titres administratifs en ayant recours à des assistants conversationnels (chatbot ou callbot [20]) pour obtenir des informations ou le service attendu.

En ajoutant des capacités d’IA aux logiciels de prise de plainte, les policiers et gendarmes nationaux en charge en unité de ces tâches pourraient en outre mieux et plus rapidement prendre en charge les victimes (obtention de rendez-vous dans un délai court via de la catégorisation, etc.). Ainsi, les services de plainte en ligne pourraient être également améliorés grâce à des possibilités offertes d’enregistrer automatiquement les plaintes et les analyser pour orienter les victimes vers les personnes compétentes et proposer la démarche la plus adaptée à l’événement (réponse automatisée avec récépissé de plainte, visioplainte avec un agent, rendez-vous en unité, etc.).

Recommandations et conclusion : Développer un modèle d’IA dans un cadre d’emploi clair et sécurisé

Les retours d’expérience réussis des JO de Paris 2024, les développements technologiques récents appellent à une nécessaire réflexion sur l’IA. En effet, le contexte sécuritaire fortement dégradé en France, une délinquance de plus en plus organisée, des métiers complexes et en tension dans lesquels le numérique est toujours plus présent (enquête, investigation), impliquent de recourir aux outils disponibles comme l’IA qui sont capables d’aider à la résolution de situations, l’élucidation d’affaires et apporter des réponses fortes pour permettre aux FSI de faire face.

L’IA n’est pas une fin en soi mais peut être un levier puissant pour améliorer le travail des FSI, comme le furent l’informatique ou la biométrie, et tel doit être le sens de cette innovation technologique [21]. Pour permettre cela, il faut donc s’assurer de :

- Un cadre politique clair pour rassurer la société dans son ensemble et stabiliser le cadre législatif.

- Une stratégie ministérielle pour sécuriser les FSI dans l’utilisation de l’IA, associée à une gouvernance claire [22].

- Une identification des bons cas d’usage de l’IA, des bons projets et de réunir les conditions pour passer à l’échelle : qualité des données pour assurer l’efficience des outils, robustesse, résilience et sécurité by-design des systèmes pour limiter les vulnérabilités face aux risques cyber venant d’une délinquance aguerrie sur ce type de menaces, auditabilité des systèmes pour comprendre et améliorer les résultats proposés par ces systèmes, etc.

- Une approche intégrée à la fois éthique, juridique et technologique pour appréhender systématiquement l’importance des données manipulées, et qui nécessitent de mettre en place des équilibres en termes de sécurité informatique et de transparence vis-à-vis de la société.

- Une identification des outils d’IA dont l’usage ne se fasse pas au prix d’une perte de souveraineté de la France et d’un risque de vulnérabilité renforcé face à des fuites de données, des cyberattaques ou des opérations d’intelligence ou d’influence (lutte informationnelle, etc.).

Faire ces pas technologiques est nécessaire pour être à la hauteur des enjeux forts de tranquillité publique et de sécurité qui se posent aujourd’hui en France.

Sources

[1] Le dilemme de l’innovateur, Clayton M. Christensen, 1997 [2] Une étude du think tank Le Continuum Lab réalisée en septembre 2024 sur les technologies de sécurité montre que 65% des Français « considèrent l’IA comme utile pour les forces de l’ordre » et 63% sont « plutôt confiants dans la possibilité de concilier liberté et sécurité grâce aux technologies » (Les Français et les technologies de sécurité : le Continuum Lab révèle une étude inédite | Continuum Lab). [3] Smartphones NEO pour Nouvel Équipement Opérationnel [4] LOI n° 2023-380 du 19 mai 2023 relative aux jeux Olympiques et Paralympiques de 2024 et portant diverses autres dispositions (1) – Légifrance (legifrance.gouv.fr) [5] Pendant les JO de Paris, la préfecture de Police de Paris a utilisé 185 caméras fixes dans le cadre de ce dispositif. [6] Intelligence artificielle : le plan d’action de la CNIL | CNIL [7] Directive « Police-Justice » : de quoi parle-t-on ? | CNIL [8] Livre blanc de la sécurité intérieure | ministère de l’Intérieur et des Outre-mer (interieur.gouv.fr) [9] LOI n° 2023-22 du 24 janvier 2023 d’orientation et de programmation du ministère de l’intérieur (1) – Légifrance (legifrance.gouv.fr) [10] Textes de la loi | Loi sur l’intelligence artificielle de l’UE (artificialintelligenceact.eu) [11] Dès février 2025, les IA interdites devront être supprimées ou mises en conformité. A compter d’août 2025, les IA encadrées et à risque limité devront être mises en conformité. [12] Dieu et la Silicon Valley, Éric Salobir (Éditions Buchet-Chastel, 2020) [13] Le Réseau Radio du Futur (acmoss.fr) [14] Cas par exemple des Amendes forfaitaires délictuelles rédigées sur les smartphones NEO via l’application Procès-Verbal électronique Section 9 : De la procédure de l’amende forfaitaire applicable à certains délits (Articles D45-3 à D45-21) – Légifrance (legifrance.gouv.fr) [15] La durée d’une garde à vue est de 24 heures mais peut être portée à 48 heures lorsque le délit ou le crime concerné est puni d’une peine supérieure à un an d’emprisonnement. Pour certaines infractions, elle peut atteindre jusqu’à 96 heures (trafic de stupéfiants, terrorisme, association de malfaiteurs, etc.). [16] Fichier des Personnes Recherchées, Traitement des antécédents judiciaires, etc. [17] https://www.legifrance.gouv.fr/jorf/id/JORFTEXT000050354599 [18] Perceval (plateforme de signalement des fraudes à la carte bancaire), Pharos (plateforme de signalement de contenus illicites sur internet), THESEE (plateforme de signalement des e-escroqueries), PNAV (plateforme numérique de signalement des atteintes aux personnes et de l’accompagnement des victimes), etc. [19] Masecurité.fr [20] Un callbot est un assistant vocal capable de dialoguer au téléphone avec un appelant, pour comprendre son problème et le résoudre en toute autonomie et 24h/24 sans temps d’attente. [21] Le sens de l’IA à l’école de Blaise Pascal entrepreneur, Étienne De Rocquigny (Boleine, 2023) [22] A l’instar de ce qui a été fait au ministère des Armées en mars 2024 avec une « stratégie ministérielle relative à l’IA » et une « Agence ministérielle pour l’IA de défense » (AMIAD).

Intelligence artificielle (IA) et Défense

Par Christine Dugoin-Clément,

*Chercheur associé de la chaire « Risques » de l’IAE Business School Paris 1 – La Sorbonne, à l’Observatoire de l’Intelligence Artificielle Paris 1 et au Centre de recherche de la Gendarmerie Nationale (CRGN). Ancien auditeur de l’Institut des hautes études de la défense nationale, ses travaux sont spécialisés sur l’Ukraine, la défense, les stratégies d’influence et le cyber. Elle est l’auteur de Influence et manipulations : Des conflits armés modernes aux guerres économiques (VA Éditions).

L’IA est un sujet majeur pour les sociétés et le secteur de la défense n’échappe pas à ce constat. Si le ministère des Armées peut être intéressé par des développements touchant au soutien et à la gestion administrative comparables à ce que l’on trouvera dans des organisations de tailles similaires, il est en outre intéressé par les évolutions permettant d’optimiser les missions particulières qui sont les siennes et qui demandent capacités d’adaptation et innovation pour s’adapter au milieu et à la concurrence tout en préservant la souveraineté de la technologie. Ce besoin de développement et de technologie devra compter avec un contexte particulièrement évolutif et, depuis novembre 2024, avec la présidence Trump qui risque de permettre une dérégulation du secteur américain de l’IA accroissant encore la concurrence.

Du soutien aux besoins opérationnels

La numérisation est une préoccupation de longue date pour la défense. En effet, depuis la Revolution in Military Affairs (RMA) des années 90 qui annonçait la numérisation du champ de bataille, l’innovation en matière opérationnelle a été une préoccupation majeure des armées. Concernant l’IA, dès septembre 2019, le ministère diffusait un rapport intitulé l’IA à l’appui de la défense [1] où les sujets d’intérêt étaient mis en avant tout en soulignant que le développement de l’IA n’était pas exempt de menaces et de risques et devait être pensé dans un contexte international aux prises avec de grandes tensions mondiales. Des sujets tels que l’autonomie des systèmes d’armes létaux [2] faisaient notamment l’objet d’une attentions particulières et d’un rapport du comité d’éthique quant à leurs développements et limites [3].

Concernant les armées, on trouve un intérêt en matière de développement d’IA dans plusieurs champs, dont certains se retrouve dans des secteurs plus classiques, comme les bénéfices offerts par l’IA en matière d’aide à la décision et à la planification, d’aide dans les services d’appui ou encore de logistique et préparation opérationnelle. Quelques champs seront transverses et intéresseront particulièrement d’autres structures gouvernementales comme l’IA mise au service de la cybersécurité et de la compréhension et de la prévention de l’influence numérique, d’autant plus que l’influence a été consacrée priorité stratégique dans la Revue Nationale Stratégique de 2022 [4]. D’autres sujets seront par nature bien plus spécifiques, on pensera à l’usage de systèmes d’IA pour le combat collaboratif, pour le renseignement ou encore pour de la robotique et de l’autonomie dédiées aux enjeux militaires. Ces besoins en matière de systèmes d’IA ont augmenté avec l’approche multi-domaines multi-champs (MDMC), inhérente à la conflictualité moderne, et avec le retour de la guerre de haute intensité illustrée par l’invasion de l’Ukraine opérée par la Russie, avec la guerre au Moyen-Orient. Autre acteur de l’augmentation du besoin, les montées de tensions globales qui se jouent du silotage des lectures traditionnelles pour au contraire traverser les différents champs de conflictualité, que ce soit en passant du monde physique au numérique dans des actions d’influence et de déstabilisations, en activant des tensions et disputes dans diverses aires géographiques, ou en mobilisant et perturbant divers champs mobilisables, comme les aspects industriels et financiers ou encore le volet social et sociétal [5].

De plus, l’approche MDMC demande de capter une masse d’information de plus en plus importante. Dès lors, elle fait office de centre de commande et de contrôle (C2C) le point névralgique de la gestion des conflits. Dans ce cadre, l’IA pourrait être un ressort important notamment dans le traitement efficace de données massives venant irriguer ces centres de commandements. Mais encore faut-il capter ces données, ce qui, là encore, supposera de disposer de systèmes reposant sur des IA performantes, que l’on pense à des capteurs traditionnels, à l’intégration dans des systèmes d’information préexistant, ou à la gestion des constellations satellites et des données qu’elles captent [6] qui permettent une forme de transparence tactique du champ de bataille. Or, dans ce champ spécifique particulièrement coûteux et technologique, les armées doivent travailler en collaboration avec d’autres agences mais aussi avec des sociétés privées, qui détiennent une partie non négligeable des constellations : on pensera alors notamment à des structures comme OneWeb, Intelsat ou encore Starshield, la branche militaire de Starlink, société d’Elon Musk, nouvellement promu à la tête du ministère de l’efficacité gouvernementale » aux USA. Enfin, un nouvel entrant est apparu sur le champ de bataille avec l’Ukraine mais aussi avec le Haut Karabakh : les drones. Qu’ils soient terrestres, marins ou aériens, ils sont aujourd’hui incontournables sur le champ de bataille et peuvent parfois reposer sur des IAs demandant robustesse et innovation. En nous projetant dans un futurs proche on pensera aux ailiers loyaux, drones aériens massifs devant, à terme, collaborer avec les pilotes de chasses [7], ou encore aux drones en essaims qui ont recours à des IA permettant de calculer et d’organiser les mouvements de l’ensemble.

Innovation, dérégulation et défense

Enfin, l’élection de Donald Trump qui sera le 47e président des USA risque de modifier fondamentalement les réglementations préalablement en cours en matière d’IA. Donald Trump aspire à libérer les capacités d’innovation qu’il estime être bridées par les réglementations de l’administration Biden [8]. Si le manifeste du candidat Trump plaidait pour abroger ce qu’il estimait nuire à la liberté d’expression et à « l’épanouissement de l’être humain », faisant craindre une dérégulation de la modération en ligne à l’heure ou la désinformation et l’influence sont des pièces maîtresses de la guerre cognitive et informationnelle, un autre volet touchait aux principes de précaution, voire d’éthique. Cela prend un sens particulier quand on se souvient que l’on retrouve parmi les partisans et financiers de Trump des investisseurs en capital-risque de la Silicon Valley comme Marc Andreessen, qui se décrit comme un « techno-optimiste, un « accélérateur d’IA » souhaitant transformer l’humanité en une race de « surhommes technologiques » [9]. Cependant, les déclarations visant à abroger le décret de Biden sur l’IA restent floues, les agences fédérales continuant à exercer une surveillance sur de plusieurs aspects du déploiement de l’IA. Même si ces poussées pourront être limitées par les agences, il est probable que les projets de dérégulations de Trump ne donnent un coup d’accélérateur à l’industrie américaine en permettant de tester de nouvelles applications d’IA avec plus de liberté. A ce titre, abandonner des règles comme celle de l’AISI relative à la transparence accélérerait le développement, pour autant, mais le fait qu’il n’y ai plus de d’approche fédérale unifiée sur le sujet participera à augmenter les différences entre états et pourra être facteur de complexité pour le secteur de l’IA.

Concernant l’écosystème de la Défense, que pourrait donner la 47e présidence alors qu’en octobre 2024, la secrétaire adjointe à la défense, Kathleen Hicks, parlait de l’engagement du ministère de la défense (DoD) à devenir un leader mondial dans l’élaboration de politiques éthiques saines pour l’utilisation militaire de l’IA [10]? Donald Trump, notamment encouragé par Elon Musk [11], vise à créer un environnement plus libre pour le développement de l’IA pour garantir aux USA de conserver leur avance sur des concurrents mondiaux comme la Chine. Pour autant en matière de défense on risque d’assister à un premier moment d’hésitation dû au flou entre réglementations précédentes comme le Responsible AI Strategy and Implementation Pathway [12], ou le mémo d’octobre dernier relatif aux cas d’utilisation de l’IA à des fins de sécurité nationale [13]. Cependant, les révisions de décrets envisagées vont probablement alléger les obligations de souscrire aux normes éthiques au bénéfice de l’innovation et vont probablement encourager les contributions du secteur privé, sujet au cœur du programme de Donald Trump axé sur l’innovation.

Dans ce cadre, il ne serait pas surprenant d’observer une montée en puissance de l’IA, potentiellement particulièrement prononcée dans des domaines où secteur public et privé doivent collaborer comme c’est le cas en matière de gestion de constellation satellitaire et de traitement de données issus de ces capteurs spécifiques.

Dans ce cadre, l’UE, devra probablement faire face à une concurrence agressive tout en restant alignée avec l’AI ACT [14], parfois perçu comme étant une approche risquée pour le maintien de la compétitivité du secteur à cause de son cadre stricte. S’il n’est pas question ici de prôner une dérégulation, il faut néanmoins intégrer que le souci européen du respect des règles d’éthiques dans un contexte de dérégulation massive risque de poser un dilemme en matière de développement technologique sur lequel entreprises et commanditaires doivent d’ores et déjà se pencher.

Sources

[1]https://www.defense.gouv.fr/sites/default/files/aid/Report%20of%20the%20AI%20Task%20Force%20September%202019.pdf

[2]https://theconversation.com/armes-autonomes-et-soldats-augmentes-quel-impact-sur-les-valeurs-des-armees-168295

[3]https://archives.defense.gouv.fr/actualites/la-vie-du-ministere/communique_le-comite-d-ethique-de-la-defense-publie-son-rapport-sur-l-integration-de-l-autonomie-des-systemes-d-armes-letaux.html

[4]https://www.defnat.com/e-RDN/vue-article.php?carticle=23071

[5]https://www.defnat.com/e-RDN/vue-article.php?carticle=23532

[6]Dugoin-Clément, C. 2024. Le spatial, entre transparence tactique et développement technologique, Def tech décembre 2024

[7]https://revistacugc.es/article/view/5764

[8]https://rncplatform.donaldjtrump.com/?_gl=1*1dhufmh*_gcl_au*NDMyMDY5MTguMTcyOTU4NzI2Nw..&_ga=2.255281992.1180040526.1729587267-1531562902.1729587267

[9]https://a16z.com/the-techno-optimist-manifesto/

[10]https://www.defense.gov/News/News-Stories/Article/Article/3949441/hicks-highlights-dods-commitment-to-responsible-ai-use/

[11] https://youtu.be/7qZl_5xHoBw?si=71ck81CSGcGqxrrZ [12]https://media.defense.gov/2022/Jun/22/2003022604/-1/-1/0/Department-of-Defense-Responsible-Artificial-Intelligence-Strategy-and-Implementation-Pathway.PDF

[13]https://www.whitehouse.gov/briefing-room/presidential-actions/2024/10/24/memorandum-on-advancing-the-united-states-leadership-in-artificial-intelligence-harnessing-artificial-intelligence-to-fulfill-national-security-objectives-and-fostering-the-safety-security/

[14]https://www.euaiact.com/

Vulgarisation de l’intelligence artificielle pour en comprendre son fonctionnement

Par Dr. Cyril-Alexandre Pachon,

*Cyril-Alexandre Pachon est docteur en Informatique, Systèmes et Communication. Pendant ses premiers travaux de recherche, il contribue à la normalisation des tests automatiques de conformité et de robustesse. Il effectue les premières recherches et résultats au sein d’actions spécifiques du CNRS sur la sécurité des systèmes logiciels. Ses présentations exposent des solutions sur les politiques de sécurité et la détection d’erreurs en présence d’aléas. En 2020, il devient directeur des études et directeur du cursus IA à l’école Hexagone. Ce cursus se compose des métiers en Data analyste, Data scientiste, Architecte Machine Learning et Architecte Deep Learning.

L’informatique, en constante évolution, se place au centre de notre société moderne. Ses sphères sont la programmation, les bases de données, les réseaux, l’intelligence artificielle, la cybersécurité, la cyberdéfense et bien d’autres. L’axe de travail de l’informatique est de transformer des données en une information numérique exploitable. Son utilisation se retrouve dans les métiers de la santé, la finance, la sécurité, les technologies de l’information, l’éducation, les ressources humaines, le tourisme, l’hôtellerie, le transport, la logistique, le divertissement, les arts, la culture et bien d’autres.

Cadre général

Pour offrir un premier cadre général, l’environnement de développement en informatique est une discipline constituée, de données (numériques ou analogiques), dont les informations calculées ou produites sont stockées en masse (Big Data), et d’instructions de traitements (programmes, applications, systèmes, apprentissage automatique, Internet des objets, …). Pour le décrire, il représente un ensemble de techniques et de méthodes pour traiter et simuler notre monde réel. Pour déployer les modèles automatiques, la principale clef est de disposer de données fiables contrôlées et protégées pour en exploiter les informations :

- Les données : Il s’agit de valeurs brutes, de chiffres, de textes, d’images, de sons, … pas encore été traités. Les données sont structurées (bases de données, tableaux, …) ou non structurées (textes, images, sons, …).

- Les informations : Il s’agit de résultats produits après le traitement sur les données. Elles ont du sens et deviennent utiles pour une prise de décision. Par exemple, une simple série de mesures numériques (données) s’analyse par traitement pour déterminer une tendance climatique (information).

Principes généraux de l’IA

L’Intelligence Artificielle (IA) est une des branches de cette informatique. Ses développeurs en Data science s’efforcent de reproduire, d’extraire et de construire avec des modélisations (équation, mécanique, physique, comportement, concept, etc.) des actions « réelles » et/ou « usuelles » à partir de données. Les modèles d’IA deviennent les architectures et les données deviennent ses caractéristiques.

Aujourd’hui l’IA se retrouve au quotidien dans nos vies (visible ou cachée). Par conséquent, existe-t-il plusieurs IA ? Comment la définir ? Est-elle sécurisée ? Influence-t-elle nos modes de vie, nos pensées ? Qu’attendre du futur en termes d’IA ?

Un premier modèle d’apprentissage automatique est une architecture d’IA supervisée (Machine Learning) formée à partir d’un ensemble de données (caractéristiques) et de cibles étiquetées connues. Ce modèle mathématique s’attarde à construire les liens fonctionnels entre les entrées et les cibles, pour en prédire les sorties connues (par exemple reconnaître des animaux, des objets, …). Les principaux composant et étapes sont :

- Collecte des données et cibles étiquetées, nettoyage des données.

- Entraînement : Algorithmes et modèles (analyses statistiques, calculs de distances, simulations, …) pour transformer les données en informations utiles pour définir l’IA.

- Évaluation : Ensemble de tests pour vérifier la capacité de l’IA à prédire correctement les résultats.

- Visualisation des informations : Sous forme de graphiques, de tableaux pour faciliter la compréhension et l’utilisation des résultats.

Un deuxième modèle d’apprentissage automatique est une architecture d’IA non supervisée (Deep Learning) utilisant des modèles et des techniques pour apprendre seule à partir de données sans cibles et étiquettes définies. L’architecture cherche seulement à identifier des structures ou des motifs cachés dans les données pour les classer. Les principaux composants et étapes sont :

- Collecte des données d’entrée : Venant du Web scraping (données du web), des sondages et questionnaires, des demandes auprès d’utilisateurs, des vidéos, des jeux vidéo, des capteurs et en quelque sorte toutes les données existantes dans l’environnement pour l’IA.

- Nettoyage des données : Avec expertise pour éliminer les doublons, gérer les valeurs manquantes et corriger les erreurs.

- Normalisation/Standardisation : Avec expertise pour ajuster les échelles des variables pour éviter que certaines caractéristiques dominent.

- Entraînement : Avec expertise pour sélectionner et implémenter un algorithme approprié avec identification et extraction des caractéristiques pertinentes pour construire l’architecture.

- Évaluation de la performance des résultats : Pour interpréter les résultats pour comprendre leur signification dans le contexte du problème.

Pour aller plus loin, un réseau de neurones est utilisé pour avoir plus de précisions dans les systèmes automatiques. Il s’agit d’une architecture inspirée du cerveau humain capable d’apprendre des représentations complexes, classification d’images, traduction automatique, etc.

Modèles d’IA

Chaque modèle d’IA a ses propres caractéristiques, avantages et inconvénients, et le bon choix dépend de la nature des données et de la tâche à accomplir. Il n’existe pas un seul « meilleur » modèle d’IA pour détecter et contrer les intrusions dans un réseau. Il dépend de plusieurs facteurs, notamment la nature du réseau, le type d’attaques visées, et les ressources disponibles :

- Détection des intrusions : Les IDS (Systèmes de Détection d’Intrusions) utilisent des modèles d’apprentissage automatique pour identifier les comportements anormaux ou malveillants sur un réseau. Ils analysent des volumes de données en temps réel pour détecter des menaces potentielles.

- Analyse des malwares : L’IA est utilisée pour analyser et classifier des fichiers suspects. Des modèles de machine Learning sont formés pour reconnaître des signatures de malwares connus et des comportements anormaux indiquant une nouvelle variante de malware.

- Phishing et fraude : L’IA analyse les e-mails et les sites web pour détecter des tentatives de phishing. Ces systèmes évaluent les caractéristiques textuelles, les liens et d’autres facteurs pour identifier les menaces.

- Automatisation des réponses aux incidents : L’IA automatise certaines réponses aux incidents de sécurité, comme pour identifier rapidement des menaces et déclencher des actions correctives.

- Analyse prédictive : L’IA analyse les données historiques pour prédire des attaques futures ou des vulnérabilités potentielles. Les entreprises peuvent ainsi prendre des mesures proactives pour renforcer leur sécurité.

- Gestion des identités et des accès : L’IA est utilisée pour surveiller les comportements des utilisateurs et détecter des anomalies qui pourraient indiquer un accès non autorisé ou un compte compromis.

- Sécurité des IoT (Internet des objets) : Avec l’augmentation des dispositifs connectés, l’IA est utilisée pour surveiller et sécuriser les réseaux IoT, en détectant des comportements suspects ou des vulnérabilités.

Problèmes et enjeux posés par l’IA

Enfin, l’IA soulève certains problèmes et enjeux qui peuvent être classés en plusieurs catégories :

Éthique et biais :

- Biais algorithmique : L’IA reproduit ou amplifie des erreurs présentes dans les données d’entraînement, facilitant des discriminations envers certaines populations.

- Transparence : La décision prise reste opaque, rendant difficile la compréhension et l’évaluation des processus décisionnels.

- Responsabilité : Qui est responsable des erreurs ou des préjudices causés par des systèmes d’IA ? La question de la responsabilité légale reste complexe.

Cyberattaques :

- L’IA peut être utilisée pour mener des cyberattaques, rendant la sécurité informatique encore plus complexe.

Manipulation et désinformation :

- Deepfakes : La capacité de créer des contenus vidéo et audio falsifiés pour manipuler l’opinion publique et diffuser de fausses informations.

- Propagation de la désinformation : Les algorithmes peuvent favoriser la diffusion de contenus trompeurs ou biaisés sur les réseaux sociaux.

Développement soutenable :

- Consommation énergétique : Les modèles d’IA basés sur les modèles d’apprentissage, peuvent nécessiter une grande quantité d’énergie, soulevant des préoccupations environnementales.

- Exploitation des ressources : Le développement de l’IA entraîne une exploitation accrue des ressources naturelles.

Inégalités technologiques :

- Accès inégal à la technologie : Les pays et les communautés sans accès aux technologies d’IA peuvent être en difficultés, accroissant les inégalités existantes.

Ces problèmes nécessitent une attention continue, des discussions éthiques et des réglementations adaptées pour maximiser les avantages de l’IA tout en minimisant ses risques et ses impacts négatifs.

Vivre avec l’IA

Pour conclure, l’impact de l’IA se fait sentir dans presque tous les aspects de la vie moderne. À mesure que la technologie continue d’évoluer. L’importance de l’informatique et des informations qu’elles produisent ne feront qu’accroître, posant à la fois des opportunités et des défis à relever.

En reprenant les questions posées, oui, il existe plusieurs IA. Elles se définissent en fonction des demandes. Elles sont sécurisées dans la mesure du possible, mais il faut renforcer les protections. Elles influencent nos modes de vie, nos pensées, nos emplois. Il faut attendre que dans le futur les IA prennent encore plus d’importance et qu’il faudra vivre avec.

Récit du Procès Paty dans le Figaro

« La charia a frappé un professeur d’histoire-géographie simplement parce qu’il enseignait à nos enfants, à tous nos enfants, quelles sont nos valeurs », a plaidé, vendredi, Me de Montbrial, l’avocat de Mickaëlle Paty, l’une des sœurs de l’enseignant.

RÉCIT – Les avocats des parties civiles ont souligné, vendredi, la douleur et la peur durables des victimes, familles, enseignants et policiers qui, dans cet attentat, ont été happés par l’horreur.

« L’islamisme n’est pas un séparatisme, c’est un processus de conquête visant notamment le pilier numéro un de nos institutions démocratiques : l’école. » Vendredi, jour des plaidoiries des parties civiles au procès de l’assassinat de Samuel Paty, Me de Montbrial a mis les pieds dans le plat judiciaire. L’avocat de Mickaëlle Paty, l’une des sœurs de l’enseignant, a ensuite rappelé qu’en république « l’État de droit a le devoir de se défendre et qu’il doit aussi se perpétuer. C’est le rôle de l’école et c’est pour cela que les islamistes la détestent. »

Les plaidoiries des parties civiles sont toujours un moment particulier dans un procès terroriste. L’exercice en agace certains, et sur tous les bancs. Leur parole serait au mieux attendue, ennuyeuse et larmoyante, au pire redondante avec l’accusation. Le jugement est sévère et pour le moins réducteur. Car qui sont les victimes sinon des êtres happés un jour par le terrorisme ? Les plaidoiries prennent alors un tout autre sens : si, dans la dramaturgie judiciaire, l’accusation représente la société, les parties civiles, certes par l’intermédiaire de leurs avocats, font résonner la parole du citoyen ou du futur citoyen. Celle, dans le cas d’espèce, de l’homme, de la femme, de l’enfant soudain confrontés au fanatisme islamiste. Et à ce titre ils représentent aussi l’ensemble d’une population française qui, demain, pourrait aussi se retrouver devant ce fléau.

« Vive la soumission »

Cette parole prend une double forme, de raison et d’émotion, qui a trouvé son écho dans les propos entendus vendredi. Comme l’a martelé Me Ragot, qui représente avec Me de Montbrial Mickaëlle Paty, un policier municipal et la FENVAC, les parties civiles veulent « d’abord défendre leur droit de cité et leur conviction ». Cette conviction est des plus claires depuis le début du procès : Samuel Paty est mort non pour avoir discriminé des musulmans mais parce qu’il aurait insulté le prophète et parce qu’on l’a désigné comme une cible. « La charia, assène Me de Montbrial, a frappé un professeur d’histoire-géographie simplement parce qu’il enseignait à nos enfants, à tous nos enfants, quelles sont nos valeurs. »

Quelques heures plus tôt, Me Edwige, avocate de l’Association française des victimes du terrorisme (AFVT), résumait le leitmotiv des islamistes : « A bas l’éducation, vive la soumission » et expliquait que cet assassinat atroce d’un enseignant était « une chute vertigineuse des Lumières sur le bitume de l’obscurantisme ».

Vendredi, le public, dont des enseignants et anciens enseignants, a aussi entendu l’autre voix des victimes. Celle de la douleur, de la peur, des larmes. Car, pour reprendre la formule de Me de Montbrial, un attentat fait « des dégâts à fragmentation ». On a ainsi entendu Mes Parpex, Guillet et Liénard évoquer ces dégâts chez les policiers municipaux et nationaux primo-intervenants. Avec cette policière toujours très fragile qui, le 16 octobre 2020, a croisé le regard « de Samuel ». Ou avec ce policier qui, après avoir été confronté à l’horreur, se souvient des appels reçus au commissariat : « On va venger notre frère tchétchène. » À chaque fois la peur, la culpabilité…

« RIP le terroriste »

Même écho chez Me Casubolo Ferro représentant seize anciens collègues de Samuel Paty (enseignants, personnel administratif…). L’avocat se fait leur porte-parole : « Non Monsieur Paty, vos collègues ne vous ont pas abandonné, ils ont fait ce qu’ils ont pu. » Là encore, la peur, là encore, la culpabilité. Pour ces enseignants, il y eut l’angoisse d’avant l’attentat puis l’horreur du 16 octobre. Mais aussi le choc de la rentrée. Avec des élèves, détaille l’avocat, dont « la majorité était bouleversée. Mais aussi avec ceux qui avaient jeté des regards haineux (sur le professeur, NDLR), qui l’insultaient. Ceux qui continuaient à regarder et à s’envoyer la photo (de la tête) ». Le jour de la rentrée, un élève s’est « esclaffé » en assurant que la photo « ne l’avait pas choqué ». Un autre, en sixième, a écrit : « RIP le terroriste »…

Il revenait bien sûr aux avocats des Paty de faire la synthèse entre la raison et l’émotion. Me Le Roy, pour les parents et l’une des sœurs de Samuel Paty, rappelle que, quand en pleine tourmente l’enseignant s’est vu proposer de rentrer chez lui, il a répondu : « Ce serait reculer que de rentrer chez moi. » « Il a refusé d’éteindre la lumière de sa classe, poursuit l’avocate, (les islamistes) voulaient tuer cette lumière et ils ont fait entrer le terrorisme à l’école. »

Un crime suscitant « une indignation éternelle », espère Me Le Roy. Un cauchemar que vivent aussi l’ex-compagne et le fils de l’enseignant, représentés par Me Szpiner, qui a pris la parole en fin d’après-midi. On se souvient encore du témoignage de la mère expliquant que les gestes du quotidien, comme celui de placer des couteaux à table, étaient devenus difficiles. En conclusion de cette journée citoyenne, et dans l’attente du réquisitoire et des plaidoiries de la défense, on se souviendra de cette phrase de Mickaëlle Paty, relayée par Me de Montbrial et s’adressant aux institutions, dont la justice : « Ont-ils compris ce qui s’est passé (le 16 octobre 2020) ? »

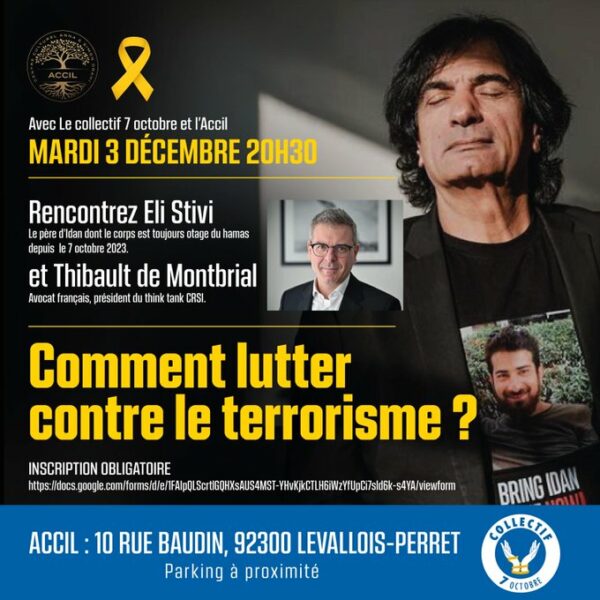

Invité par le Collectif du 7 octobre, Thibault de Montbrial est intervenu lors d’une conférence à Levallois

Devant près de 120 invités, le Président du CRSI a développé un discours sur le thème de la lutte contre le terrorisme.

Son intervention fut suivie d’un témoignage d’Eli Stivi, père d’un enfant toujours détenu par le Hamas à Gaza.

La soirée s’est ensuite poursuivie par de longs échanges sur les questions du terrorisme et de l’islamisme.

– Par Olivier DEBENEY, chef de cabinet

L’explosion des faits antisémites depuis le 7 octobre 2023

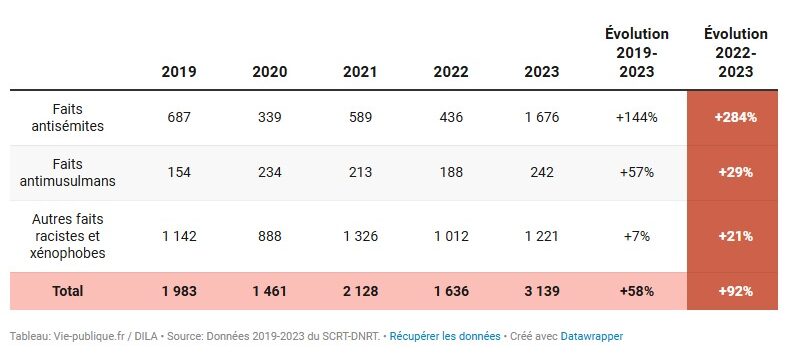

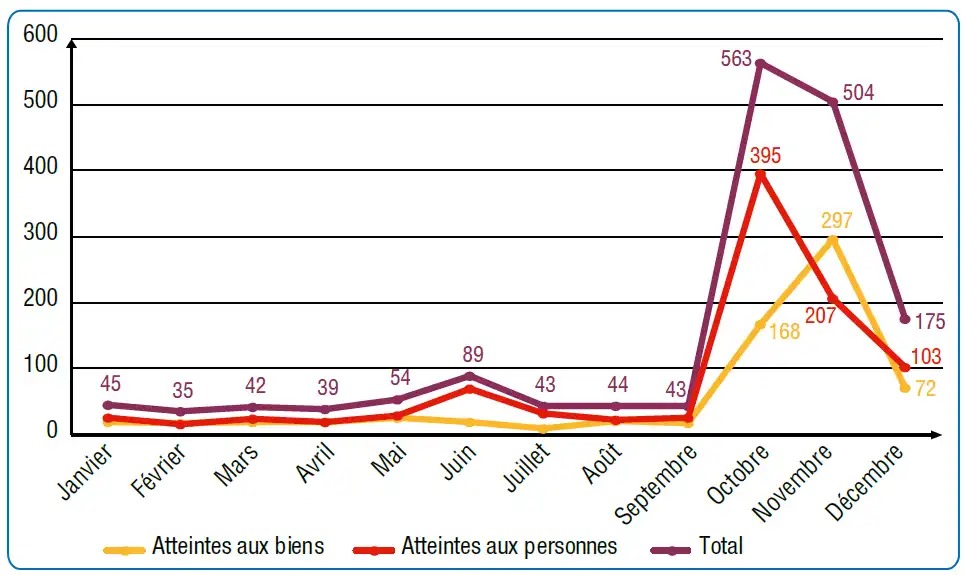

En 2023, le nombre de faits antisémites explosent passant de 436 à 1676 selon les chiffres du ministère de l’Intérieur (+284% par rapport à 2022). Entre janvier et septembre 2023, les tendances étaient fidèles à celles observées l’année précédente (malgré un pic observé en juin – 89 actes) mais le nombre d’actes antisémites passent subitement de 43 en septembre à 563 actes en octobre, soit une multiplication par 13 du nombre d’entre eux. En novembre, ces chiffres se maintiennent à 504 avant de redescendre à 175 en décembre.

Lors de la très forte augmentation observée en octobre, le nombre d’atteintes aux personnes est particulièrement impressionnant puisqu’elles passent à 395 recensées, beaucoup plus que le nombre d’atteintes aux biens (168). La moyenne mensuelle d’actes était de 48,2 entre janvier et septembre 2023. Elle passe à 414 en moyenne entre octobre et décembre 2023.

Évolution en 2024

- Pour le premier semestre 2024, ce sont 887 actes qui ont été recensés, soit +192% par rapport au premier semestre 2023.

- Ils représentent 58% des actes par rapport à l’ensemble des agressions racistes et antireligieuses.

- Les lieux de culte sont fortement touchés puisque l’augmentation en un an est de 100%, soit 45 pour le premier semestre 2024.

- Les chiffres sont les mêmes pour les écoles et les lycées.

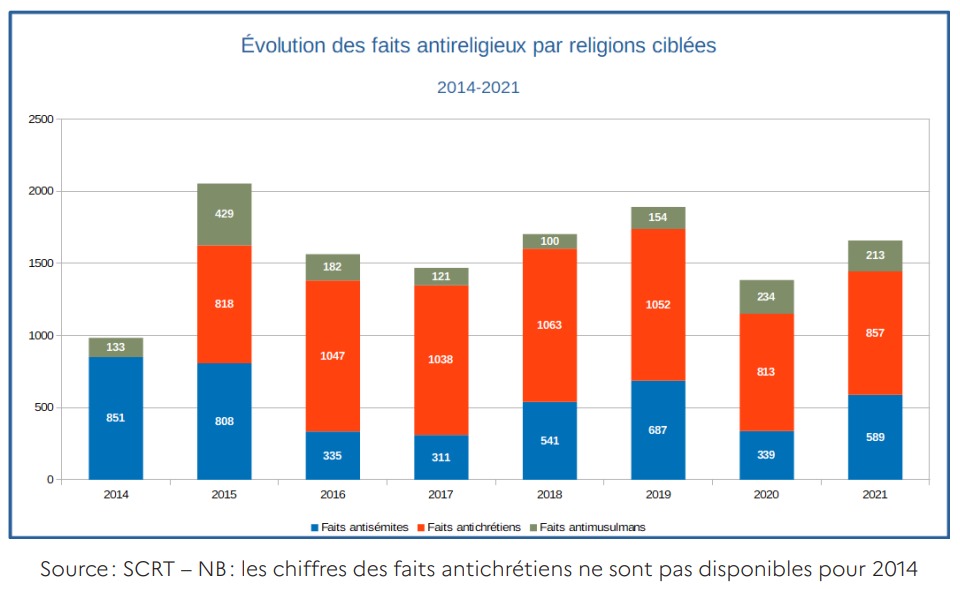

Les actes antireligieux entre 2014 et 2021

L’enquête sur les actes antireligieux entre 2014 et 2021 en France, confiée par le Premier ministre Jean Castex aux députés Isabelle Florennes et Ludovic Mendès, vise à établir un diagnostic des actes antireligieux pour dégager une tendance des actes antireligieux entre 2014 et 2021 en France. Ils reprennent les atteintes aux biens, aux personnes, les menaces et les discriminations. Au-delà des chiffres, le rapport soulignait déjà “une gravité croissante des faits”, en particulier pour les actes antisémites :

“Aux atteintes aux biens sont venues s’ajouter les atteintes aux personnes dans la sphère publique, puis les atteintes aux personnes dans la sphère privée. Le sentiment d’insécurité ou de harcèlement se déplace ainsi dans les foyers mêmes, avec le développement d’un antisémitisme « de proximité » qui ravive les traumatismes liés au meurtre de Sarah Halimi en avril 2017. 63 faits ont été recensés sur le lieu de vie en 2021, sachant que ce type d’actes risque d’être encore plus sous-estimé que ceux se déroulant dans la sphère publique.”

Le rapport met en avant que les actes anticatholiques semblent prendre le même chemin, avec une augmentation des atteintes aux personnes et non seulement des atteintes aux lieux de cultes.

Enfin il met en avant la progression des actes antimusulmans par des atteintes contre les lieux de culte sans interruption depuis 2018.